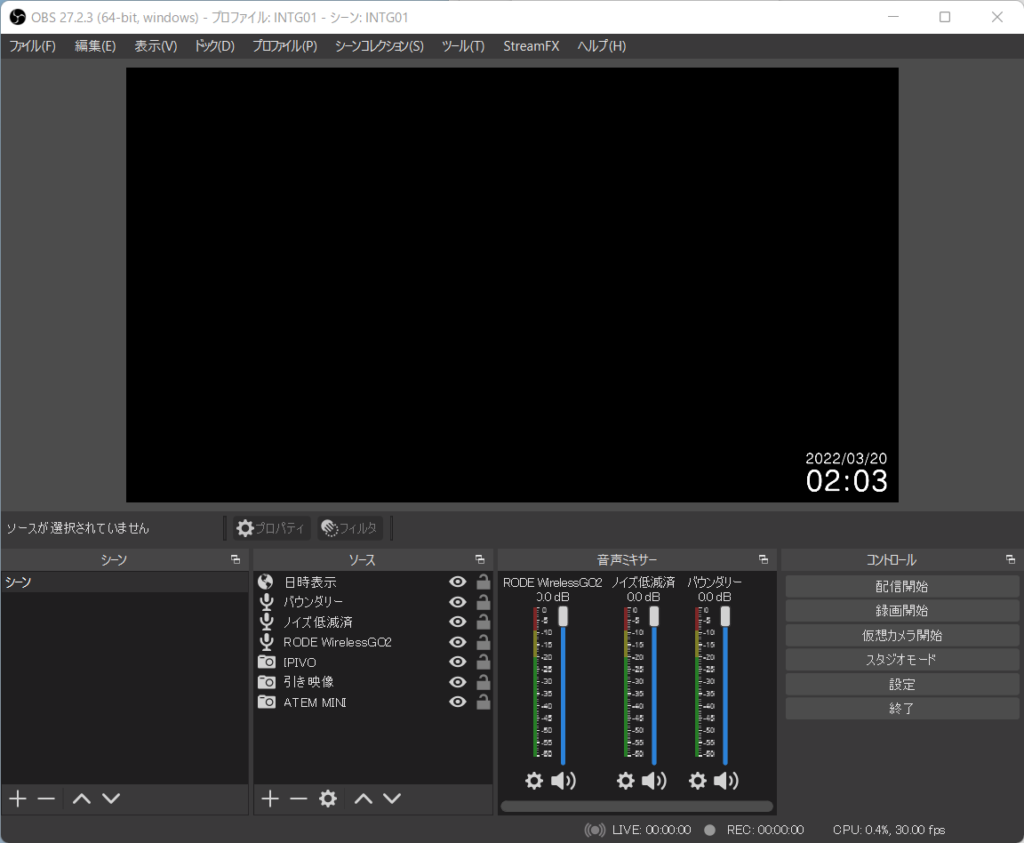

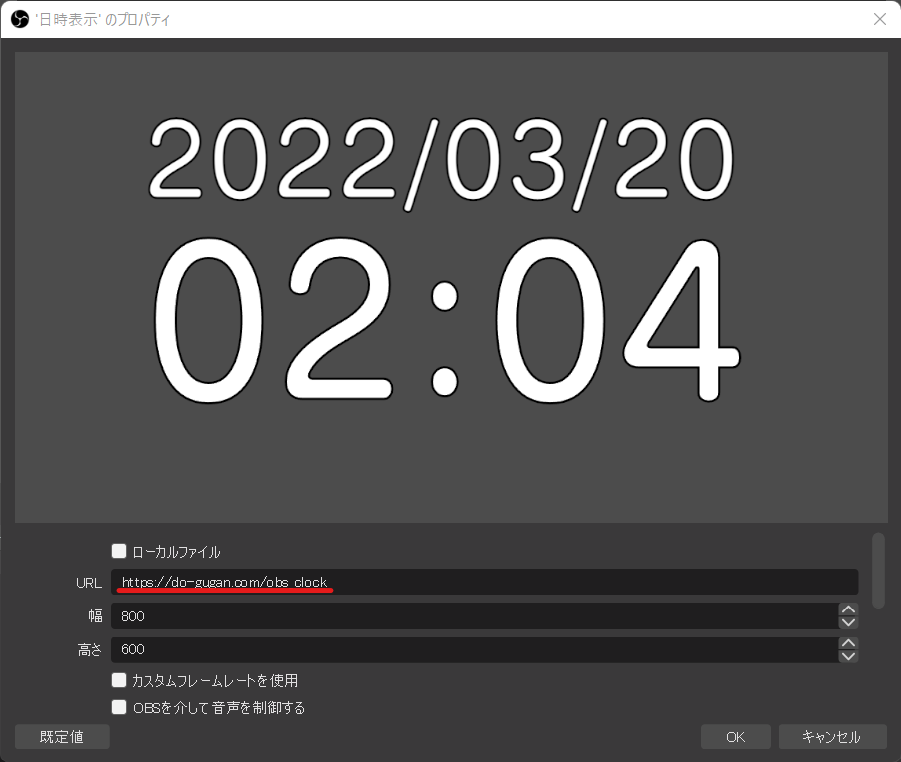

本ブログではUT/インタビューの音声収録に繰り返しRODE WirelessGoシリーズを推してきました。

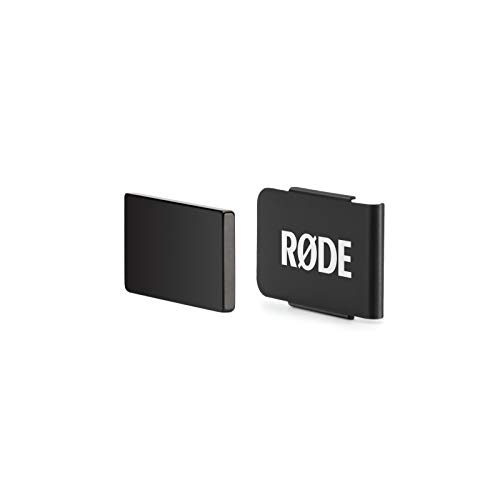

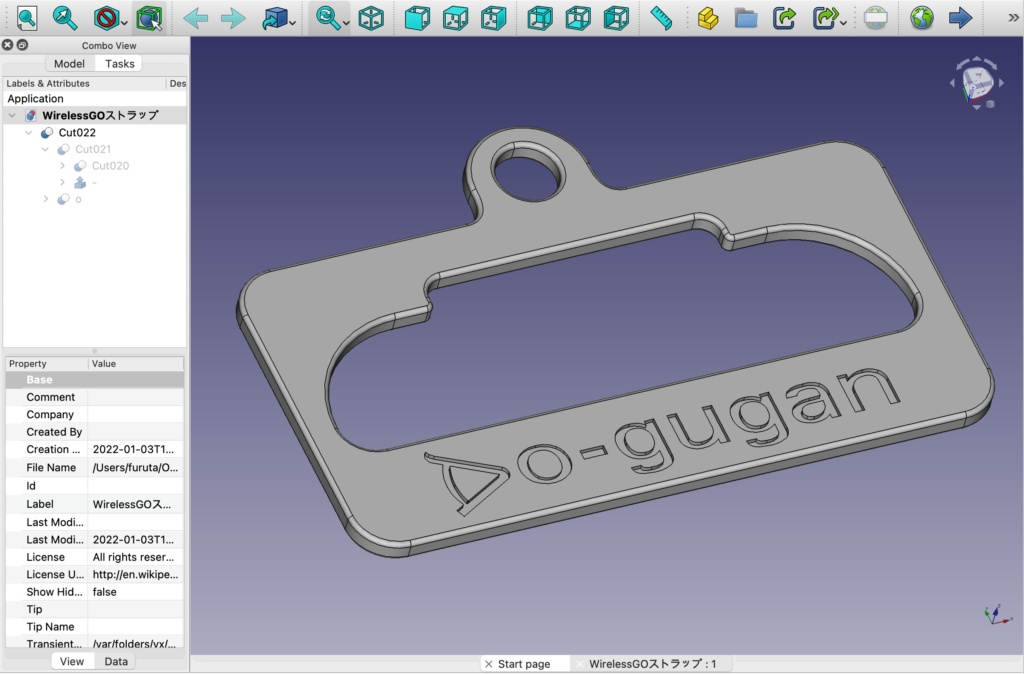

終いには3Dプリンターでオリジナルアクセサリーまで作ってみたり。

とりわけマイク(送信機)が2台ペアになったWireless GO II(以下WiGO2)は2人収録が多いUT/インタビューには最適で複数のクライアントさんにもオススメして買っていただいたりしました。

が、しかし時が経てば優れた競合が登場するもの。ドローンやジンバルで有名なDJIからDJI Micが確か2021年末くらいに発表。そこからかなりかかりましたがようやく正式に一般販売が始まったので買ってみました。60分5セッションのUTで早速使ってみたのでレビューしてみたいと思います。

■WirelessGO IIとできることの違いは?

基本的にできることは同じです。

- 2台の小型ワイヤレスマイク送信機で2名の音声を胸元などで高品質に収録できる

- 受信機1台でPCにもアナログマイク入力付きの録画機器(ATEM MINI等)にも接続可能

- 送信機内に録音ができ万一電波が途切れた時などのバックアップになる

- 背面クリップで胸ポケットやシャツの襟、合わせなどに固定できる

- マグネットプレートで衣服を挟むように固定もできる(Wireless GOでは別売り)

- 屋外で風切り音を低減させるモフモフ付属

価格も誤差の範囲しか違わないので、比較レビューも多く迷われる方も多いかも知れません。

後発だけあってDJI Micの方がマイクはやや小型。でも厚みはちょっと増す。電池スペックでは劣る(7時間->5時間)。真正面から見た時の「なんかくっついてるな」感はDJI Micの方が抑えられますが、逆に衣類の下にマグネットではさんだりした時の膨らみ方は大きくなるかも知れません。

ただUT/インタビューではそこまでマイクを目立たなくする必然性はないのでこの辺りはさほど重視はしないかなという感じです。また公称で7時間持つというバッテリーも、どのみち終日で5セッションとかいうと心許ない感じなので、結局セッションの合間に充電は必要そう。だとすると後述する充電時の利便性が効いてくるかも知れません。

■マイクとしての音質差は?

まだ両方で同時に録り比べとかして厳密に比較してはないですが、Youtubeの比較動画とかを聞いてても、わずかにWiGO2の方が明るく自然な音に聞こえます。ただ裏を返せばDJI Micの方がより近い音源=声にフォーカスして周辺雑音をカットしていると評価することもできるかな、という程度の違い。DJI Micの音は聞き比べると若干籠もった印象はありますが、音声(人の声)の聞き取りやすさという面で不利になるものではないと思います。逆に楽器とか自然音とかを録るにはもしかするとWiGO2の方がいいとかはあるかも知れません(これも厳密に比べてはないので音の傾向からの想像です)。

少し気になったのはゲイン(録音される音の大きさ)がやや低いかも?という点。これは調整できるので今回は+8dBくらいにして使いました。その分、若干周辺ノイズも増幅されてしまったかなという感はありましたが、PC側でノイズ除去処理をリアルタイムでかけて消し去れるレベルなので実質問題には感じませんでした。WiGO2の時は(接続する機器にもよりますが)むしろゲインを落として音割れを心配することの方が多かった印象です。なおゲイン調整の細かさはDJI Micの方が高そうです。

■使い勝手で大きな進化

後発のDJI Micは使い勝手の面でWiGoIIの不満点が色々と解消されている感があり、ユーザビリティ面でこちらを選ぶ理由が多いかな感じました。以下ひとつずつ説明していきます。

受信機側がタッチパネル

めちゃ小っさいですがなんとタッチパネルUIで設定が色々変更できます。普段のモニター画面から上や下からスワイプして設定項目をスライドインするような感じ。WiGO2ではボタンの長押しでON/OFFしたりサイクリック動作でゲインが何段階かに変えられたりはしますが、ちょっと込み入った設定だとPCやスマホにつないで専用アプリから書き換える必要があったりします。DJI Micでは、やりやすいかっていったらそこまでではないものの、一応受信機(親機)上ですぐに変更できるのは現場では重宝すると思います。

例えば上述のゲイン調整もスライド操作でアナログバーを左右に動かすようにして調整できます。

録音制御が柔軟

送信機本体内への録音はWiGo2では手動操作できず、上記設定ツールから、電源が入った/親機とつながった、などをトリガにして自動録音開始にするかどうかを決めておく感じ。それはそれで録音忘れなどがなくて良いのですが、例えばセッション開始を待つ間に通常各種機材はスタンバイになってますから、その間もずっと録音されていることになります。無駄にメモリやバッテリーを消費する上、後で録音データから必要な部分を探す手間も嵩んでしまいます。

一方、DJI Micの場合、マイク送信機にあるRECボタンを押したり、受信機のタッチパネルからも開始/停止できます。参加者さんが入室して事前説明で録音録画の了承を得てから回し始めることもあると思いますが、そういうタイミングで録画と一緒にちょちょっと操作して録音開始、ということも可能です。ちなみに録音を開始すると一瞬ブブっと内蔵バイブが振動しますので、衣類につけている場合ちょっと驚かれるかも知れません。「じゃぁ録音開始しますね。一瞬マイクがブルっとします。」なんて断りながらやってました。

とはいえスタートし忘れたこともやっぱりあったので、どちらが良いかは運用次第なところも。

録音データの取り出しが劇的に楽

これが地味に有り難い。WiGO2では録音データの吸い出しにも専用PCアプリが必要でした。しかもコピーというよりエクスポートという感じで内部rawデータを吸い出し時にWAVやMP3に変換しながら保存しているのか結構時間がかかります。1時間分の録音データを書き出すのに数分は待たされる感じ。高音質設定で録音すると数時間しか保存できないので、セッションの合間に吸い出したくなるんですが、ちょっとやってられない感じ。逆に全て終わってから全セッションの録音データを吸い出して置こうかな?って思ったとしても、一括吸い出しができず、1件ずつ数分置きに操作して保存しなければなりません。これはPCアプリの更新で連続書き出しくらい対応してほしいと思います。

一方DJI Micの方は普通にUSBマスストレージクラスで外付けドライブのようにマウントされます。なのでエクスプローラー/Finderで普通にドラッグコピーするだけです。時間もさしてかかりません。細かい違いですが柔軟性が全く違いますね。

2022.6.19追記:今回また90分x12セッションのUTに使った時に気付いたんですが、この機種、仕様として録音データが30分毎に分割されるようです。

トランスミッターの録音済み音声フォーマットは、24ビットモノラルWAVです。長時間録音する場合、ファイルは30分ごとに自動分割されます。最大録音時間は約14時間です。ストレージがいっぱいになった場合は、新しく録音された音声が、古い録音済み音声ファイルを上書きします。

ユーザーマニュアル v1.0より引用

90分のセッションだと3,4個のファイルができるので管理がちょい面倒ですね。その辺りのエクスポート時にきちんとつなげてくれる(そもそも内部的に分割されてるかどうかも不明ですが)RODE Centralもちょっと見直しました。緊急時のバックアップ用としてならまだいいですが、常に高音質素材として録音データを活用しようとする場合はWiGO2の方がデータはとっちらかないというメリットがあるかも知れません。

録音データの削除にPCツールがいらない

UT/インタビューではマイク内録音はバックアップであることが多いので、特にメイン録画系でトラブルが起きない限りバックアップ録音はところてん式にどんどん消えてくにまかせる、ということであればさほど気にならないかも知れません。ただそれでいうともうひとつ問題点があって、録音データは機密情報、個人情報に当たる場合が多く慎重に扱う必要があります。終わったら確実に消去しておきたい。社内で共有とかしていて、つないでみたら他のプロジェクトの録音が残ってました、とかいったら事案になりかねません。

そんな時でもWiGO2ではPCソフトにつないがないと削除ができませんが、DJI Micでは受信機(親機)のタッチパネル操作で送信機(子機)をフォーマットすることができます(ファイルを個別に選んで削除とかはできない模様)。「使い終わったらこれこれの操作をしてフォーマットしてね」的な注意書きをつけておけば大丈夫という感じになります(ちゃんとみんな守ってくれれば…)。

充電が楽

WiGO2の充電は受信機と送信機x2がそれぞれUSB-C端子になります。短いケーブルが付属してますが充電器は別売り。マルチポートのUSB充電器を別途用意しケーブルをヒドラのように生やしておく必要があります。まぁ受信機はPCのUSBにつないで使う場合は常時給電されるので良いですが。

一方DJI Micはキャリングケースが充電器を兼ねています。最近のTWS(完全ワイヤレス)イヤホンみたいにケースに差しておくだけでケース内バッテリーまたはケースにつないだ充電器から各送受信機に充電がされます。使い終わったら所定のスロットにカチっと挿しておくだけなのでひと手間少ない感じ。ただ接続が底面のポゴピンなので深く奥まで差し込まないと充電が始まらないことがありました。必ず充電ランプの点灯を確認した方が良いでしょう。

UT/インタビューではあまり関係ないですが、充電ケース内にもバッテリーがあって充電できるのでフィールドワークとかで現場移動を伴うような時は移動中にも充電ができてヨサゲですね。

■首掛けの工夫

WiGO2の時も問題になりましたが、不特定多数の方が次々に来て、かつ隠蔽のが必要ないUTやユーザ調査系のインタビューの場合、簡単に付け外しができることの優先度が高いです。お相手の服装に胸ポケットや合わせがあれば良いのですが、そうとも限りませんし、襟元やマグネットを使った固定などで本体やマグネットが素肌に触れるのも今のご時世だとちょっと気になります。

ということでWiGO2では簡単な器具を3Dプリンターで作って首掛けストラップを作成していたのは冒頭のリンク通りです。しかしDJI Micはいつもの長さ調節機構のついたストラップの付属品で簡単にぶら下げか可能でした。

そのまま充電スロットにも刺さります。

またカスタムパーツを作ろうと半ば楽しみにしてましたがちょっと肩透かし。でも普通に市販品で済むのは良いと思います。モデレータはストラップをつけたままワンタッチコネクターのところで外して充電してもいいかもですね。

■総評

まだ1回の実査、5セッションで使っただけですが、特に電波の途切れもなく音質も良好で、使い勝手は様々な面で向上しているため、これから買うならこっちでいいんじゃないかなーという気持ちが強くなっています。予備も必要なのでWiGO2も当面は手元に残しておくつもりですが、なにか問題が起きるまではDJI Micが一軍かなと思っています。

音切れという意味では一度抱け親機のタッチ操作で録音を始めたつもりが1つ隣のミュートボタンを押してしまい見学者から「参加者さんの声が遠いです〜」ってチャットメッセージもらっちゃいました。タッチパネルとはいえ画面が極小なのでこうしたミスには注意が必要そうです。時折レベルメーターに振れ幅には目を配りたいものです。

あとバッテリーは60分x3セッション終えたところで各送信機の残量が半分くらいでした。概ねカタログ値通りでしょうか。ただし録音してなかったので、録音しながらだとまた少し違うかも知れません。

感染対策でマスクしたり距離を置いたり換気したりでUT/インタビューの音声収録品質に課題を感じている方は是非検討いただければと思います。